― Windows 11を“我慢して”使いながら、最新AIマシンの実力を測る ―

PC高騰の年末、待つのをやめた

2025年の年末、

CPU・GPU・ミニPCといったハードウェア全体の価格が、

じわじわと、しかし確実に上がり始めているのを感じていた。

SNSでは多くのインフルエンサーが今欲しい人は早く買った方がいい、あとで後悔すると煽っている。

このままだと「もう少し様子を見るか」と思っている間に、

それがそのまま 値上がりを待つ行為 になりそうな空気もある。

というわけで、今回筆者も煽りに乗っかり、というか

もはや迷っている時間そのものもコストだなと割り切って、

Minisforum AI X1 Pro(96GB / 2TB)を駆け込みで購入した。

来年になったらこの値段じゃ済まないなという気持ちと、

あとは今の手持ちのPCも少し高く売れるんじゃね?という気持ちもあって、

それらが今回の購入を後押しした。

なぜAI X1 Proだったのか

ちなみに今回AI X1 Proをなぜ選んだのか?

なぜmacOSにしないのか?

と筆者のブログ読者なら思うでしょう。

ここで以前の筆者ならmac miniとか、Mac Studioとか考えていただろう。

macOSマニアなのに、なぜmacを買わないのか?

その理由は、決まっているじゃないですか、「えーあい」です。

はい、「AI」です、「Apple Inteligence」じゃないAIをいじりたい。

しかもローカルLLMで!

高速なマシンでローカルLLMを動かしたいんです。

で、MinisForumのAI X1 Proが値段的には手が届く範囲だった、というわけです。

余裕があれば同社の上位クラスの「MS-S1 MAX」が欲しいですが、

そこまでは・・・ね、というわけで、「AI X1 Pro」をポチっとしました。

- AMD Ryzen 370HX 搭載

- NPUを内蔵した“最新AIマシン”とされる構成

- メモリを最初から大容量で積める(今回は96GBとしましたよ!)

- Oculinkによる外部GPU拡張(これは嬉しい。手持ちのGPUが使える!)

- SSDを最大3枚搭載可能(Linuxとデュアルブートが可能!)

そして何より、

型落ち気味の中古PCと、

「最新AI向け」と言われるマシンの差が、

実際どれくらいあるのかを確かめたかった

という点が大きい。

カタログスペックではなく、

実作業・実測ベースでどれほど違うのか。

その観測点として、AIX1 Proはちょうど良かった。

Windows 11 初期設定でまずやったこと

早速、年末に届いたんですが、

いきなりLinuxインストールというのも男気が過ぎるんで、

まずはWIndowsでどこまでできるか、使ってやろうということで、

久しぶりのWindowsのセットアップを行う。。。

しかし、ユーザ登録でクラウド連携させられそうになる。

ここは連携したくない、ローカルユーザで使いたい。

クラウド連携ユーザをスキップ

セットアップで最初にやったのはこれだ。

手順はネットで検索して、見つけた以下手順を実施。

- セットアップ画面で「Shift」キーと「F10」キーを押す。

- コマンドプロンプトが表示される。

- そのウィンドウをマウスでクリックなどしてアクティブにする。

- 「start ms-cxh:localonly」と入力して「Enter」キーを押す。

- ローカルアカウントを作るためのウィンドウが表示される。

- 任意のユーザー名とパスワードを入力して「次へ」を押す。

これでローカルアカウントでのセットアップが完了した。

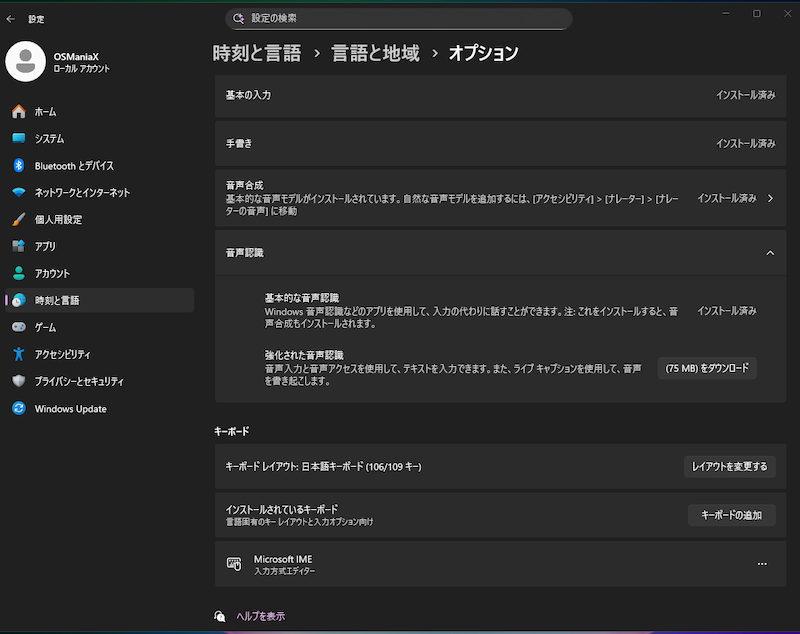

USキーボードから日本語配列へ

初期状態はUSキーボード設定だった。

- 設定 → 時刻と言語→言語と地域→オプション

- キーボードレイアウト→日本語キーボードへ変更

これがなかなか見つかりにくい場所にあったので、一応記載しておく。

正直な感想:Windows 11は本当にうっとうしい

ここは感情として、はっきり書いておく。

Windows 11は、とにかく広告が多い。

- タスクバー

- スタートメニュー

- 「おすすめ」やサジェスト

- OneDriveへのバックアップを勧めてくる(しかもCドライブにびっくりマーク)

なぜだろうか、お金を払ってOSを買っているにもかかわらず、

こうした広告を見せられる前提のUIというのは正直納得がいかない。

個人的な感想ではあるが、普通にマルウェアレベルのOSでは?と疑問に感じてしまう。

macOSやLinuxに慣れている身としては、

こういうところが鬱陶しい気持ちにさせられるOSだよな、というのが本音だ。

Windows 11は“選択”ではなく、比較のための基準OS

ちなみに今回はメインマシンを macOS から Windows 11 に移行したいわけではない。

筆者は今でもmacOSやLinuxが好きだ、その根底にあるのは

sshでのリモート作業などを多用するインフラエンジニアの身としては

- 長年親しんだUIの一貫性

- シェルが使えることでの作業効率

- Unixベースのターミナルがある安心感

という点では、Windowsは及ばない領域だと言える。

だが、今回Windows 11を使っている理由は別にある。

AMD 370HX+NPU を積んだ“最新AIマシン”で

ローカルLLMなどの生成AIを遊び尽くしたい。

これまでの型落ち中古PCでのAI性能と比べて、

どれだけの差があるのかを検証してみたいからだ。

- CPU世代差は体感でどれくらい出るのか

- メモリ容量が増えると何が変わるのか

- ローカルLLM(ollama)などの推論速度はどれほど違うのか

というわけで、今回のWindows 11は「使いたいOS」ではなく、

一旦、比較実験のためのOSとして使っている、という位置づけであるので

Windows派に宗派を乗り換えたわけではないので安心して欲しい。

もちろん今後はLinuxをインストールしての性能差も確認していきたいと思っている。

そんなこんなでWindows11のアップデートを全て実施し、25H2にした。

少し前に最新の25H2は不具合が出ているニュースを目にしたが、既に改修されたのか不具合はなかった。

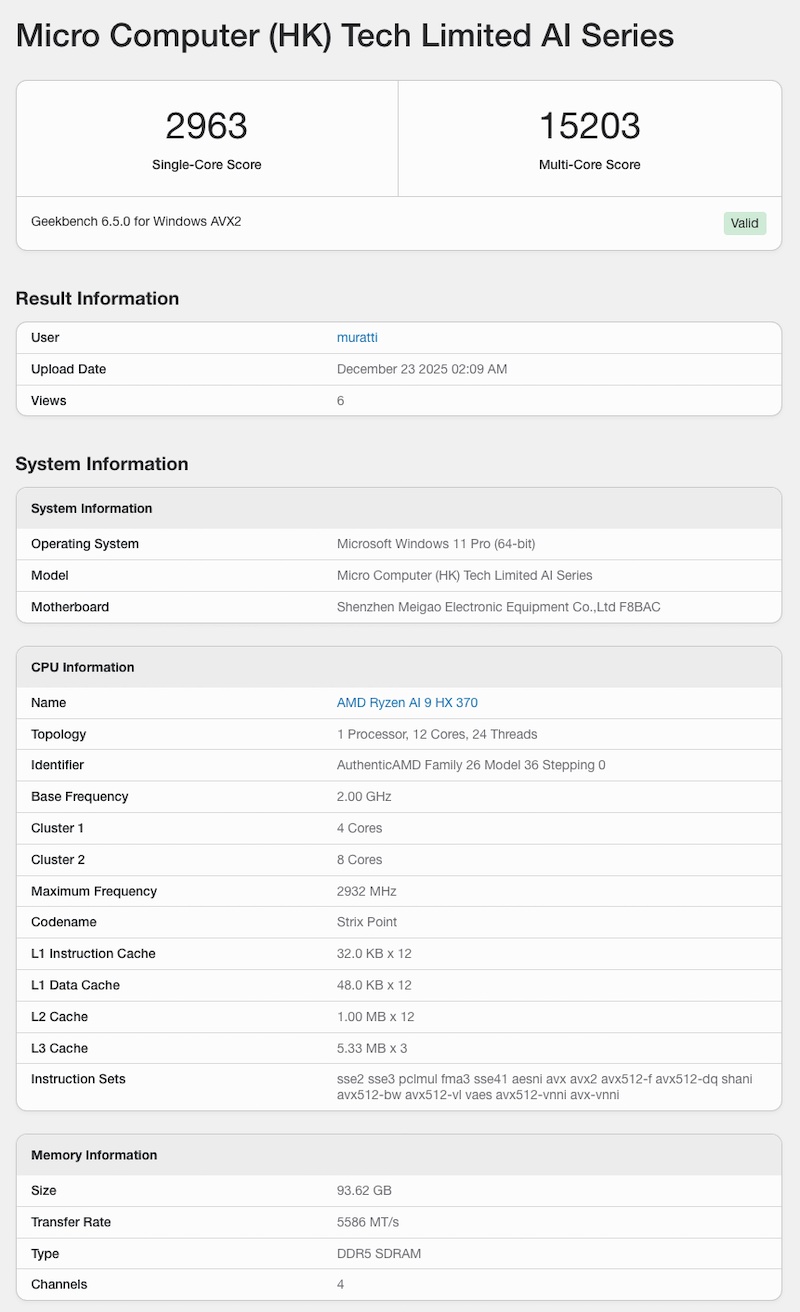

AMD 370HXのGeekBench結果

以下、AMD 370HXのGeekBenchの結果である。

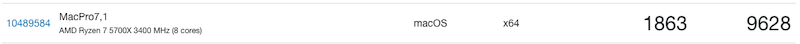

シングルスコア、マルチコアともにこれまでのメインであったRyzentosh機(1863 / 9628)では叶わない。

いやはやバケモノ級である。

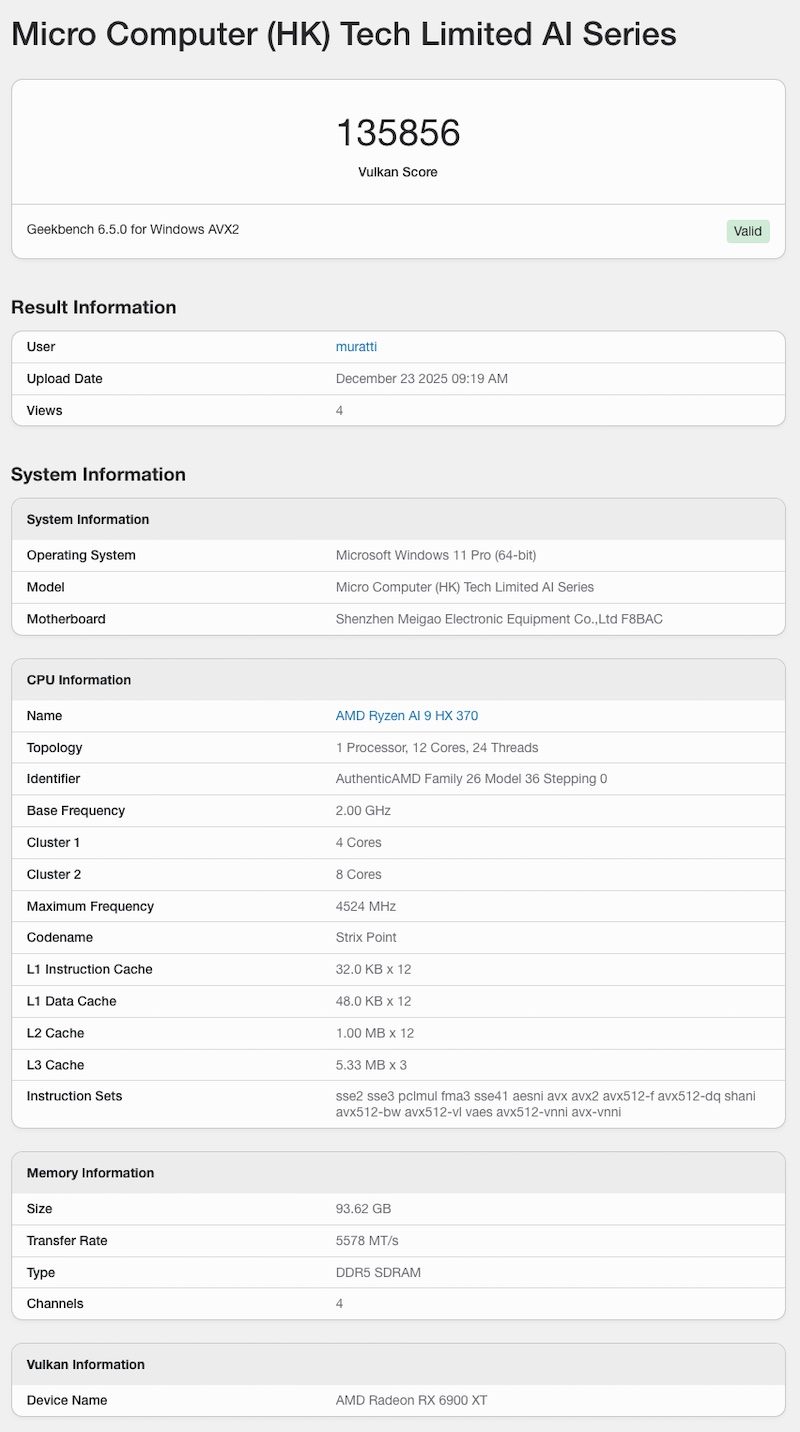

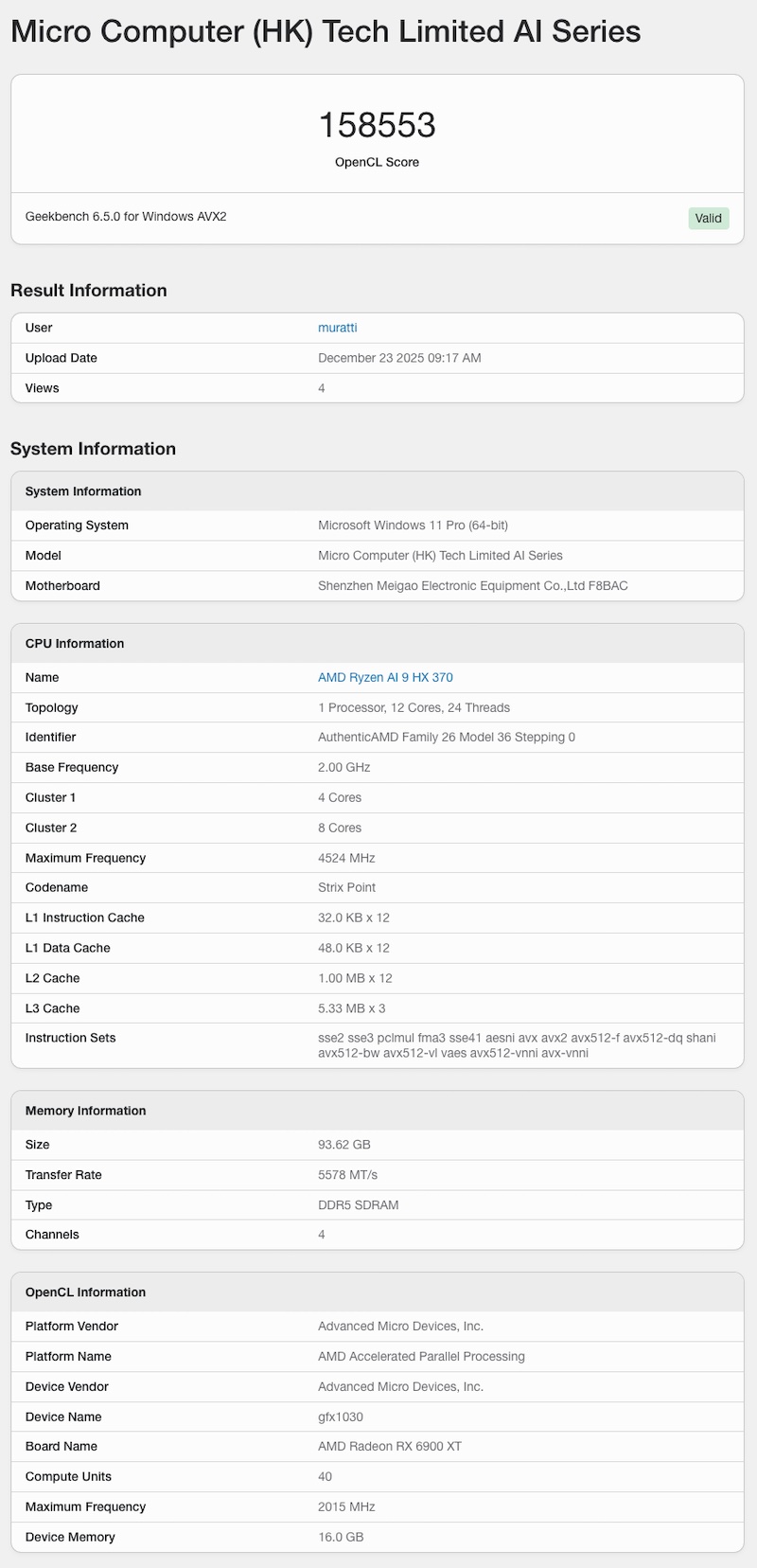

では、GPUも見ていこう。

Oculink × RX6900XT を試す

次にAI X1 Proの特徴の一つが Oculink だ。

手持ち(Ryzentoshで使っていた)の RX6900XT を接続し、動作確認とベンチマークを行ってみた。

- 認識:OcuLink接続は問題なし(本体電源とDockの電源が連動しているのが地味にありがたい)

- 動作:安定

- 体感:内蔵GPU(890M)とは完全に別物

ちなみに890MはRX5500XTと同レベルのGeekBench結果であった。

RX6900XTでのGeekBenchの結果

以下、RX6900XTでのGeekBenchの結果である。

HackintoshではMetalでは性能が出ていたが、OpenCLでは活かしきれていなかった。

この差はすさまじい。

この性能は、eGPUとはいえ、PCIe以上なんじゃないか、という感覚すらある。

ローカルLLMを一通り試す

まずは以下のローカルLLMを試してみた。

- Ollama

- LM Studio

- Amuse(画像、動画)

AIX1 ProのCPU性能とメモリ容量が効いていて、

OllamaとLM Studioに関しては推論で待たされる感覚はほとんどない。

ブラウザベースのChatGPTやGeminiと遜色ないスピードで応答してくれるのには驚いた。

またLM StudioではこれまでOllamaではメモリの制約上で

試せなかったgpt-oss 系モデルが使えるのが嬉しい。

今回は購入直後の簡単な性能検証レポートということで、

ローカルLLMに関する詳細はまた別途レポートしていく予定だ。

ローカルLLMは「実験対象」ではなくなった

まだ数日ではあるが、AI X1 Proでローカル生成AIを一通り試して感じたのは、

ローカルLLMは、

もはや実験対象ではなく、

日常的に使える道具にすでになりつつある

という点だ。

クラウドに投げなくてもいいレスポンスで応答してくれる。

これは今までの型落ち中古PCでは味わえなかった気分だ。

AI X1 Proを触って分かったローカルLLMの現在地

AIX1 Proは、ローカルLLM用のAI実験機として購入したが、

今後のAIはもうクラウドではなく、ローカルでいいんじゃないかと思えた自分がいる。

年末に駆け込みで買ったが、触ってみて、この先のAIの未来予測ができそうである。

そして、クラウドに頼らず、ローカルLLMをどう使っていくのが正解かもしれない。

今はローカルLLMのAIインフラ設計はどうあるべきかを考え始めている。

次回以降の検証予定

実はAI X1 Proは SSDを3枚搭載可能 な構成だ。

というわけで今後はこの点を活かし、Linuxとデュアルブート構成にし、

ローカルLLMの検証の他、LinuxでのeGPUは使えるのか。

GeekBenchや、Steamなどのゲーム検証、MIDIキーボードでのDTMなども含め

各種筆者の興味ある分野で少しづつ検証をしていきたいと思っている。

締め

AI X1 Proを購入してから久しぶりにワクワクしている。

MacStudioやMacminiを買ってもこの感覚は得られなかっただろう。

2026年はAI X1 ProでAI関連を使い倒していきたい。

興味ある方は検証結果について継続的にウォッチしてくれたら嬉しい限りである。